ก่อนเวอชั่น vSphere 4.1 แอดมินไม่สามารถกำหนดจำนวน Core ให้กับ vCPU ของตนเองได้

ซึ่งโดยทั่วไปแล้ว (เวอร์ชั่นก่อนๆ)1 vCPU คือ 1 CPU socket สำหรับ Guest VM "ดังนั้น Windows 2003 Standard VM ก็จะใส่ได้แค่ 4 vCPU เนื่องจาก win standard support สูงสุดที่ 4 socket "

จากประโยคข้างบน หลายคนคงเริ่มบ่น เนื่องจากไม่คุ้มกับค่าlicenseอย่างมากกก เพราะถ้าเทียบกับการใช้งานบนเครื่อง physical เราสามารถใช้งาน CPUได้มากกว่า 4 โดยการซื้อ multi-core processor มาใช้งาน อาทิเช่น ใช้ 2 quad-core processor จะทำให้ Windows มองเห็นถึง 8 logical processor เลยทีเดียว

เพื่อแก้ปัญหาตรงนี้ ในเวอชั่น vSphere 4.1 จึงเพิ่ม feature ตรงนี้ขึ้นมา แต่จะต้องเข้าไปแก้ใน advance option ซึ่งบางคนอาจจะไม่ชอบใจนัก ดังนั้นใน vSphere 5 จึงมีเมนูให้กำหนด virtual core ให้ตั้งแต่แรก ดังรูป

ท้ายสุด หลายๆคนก็จะถามกลับมาว่า "ถ้างั้นระหว่าง 4 virtual socket / 1 virtual core กับ 2 virtual socket /2 virtual core ผมควรจะกำหนดอย่างไรดี เนื่องจากทั้งคู่ได้ผลลัพธ์เท่ากัน"

ผมแนะนำอย่างนี้คับ ถ้าไม่มีความจำเป็นหรือไม่ติดเรื่อง license ก็ให้ใช้ virtual core เป็น 1 ไปคับ แล้วเซ็ต virtual socket ตามความต้องการ จะเหมาะสมที่สุดคับ

Wednesday, September 28, 2011

Friday, September 23, 2011

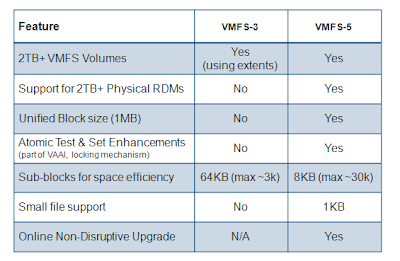

VMFS5 versus VMFS3

วันนี้ผมมีโอกาสได้ลองเล่น VMFS 5 (VMware File System) ที่มากับ vSphere5

และพอดีไปเจอตารางเปรียบเทียบ ของทาง VMware มา เลยอยากจะเอามาแชร์ให้คับ

1.จะเห็นได้ว่า VMFS5 นั้นไม่มีลิมิตขนาดDatastore ไว้ที่ 2 TB อีกต่อไป เนื่องจากเปลี่ยนไปใช้ Partition Table แบบ GPT (เหมือนกับของ Windows 2008 )

2. จาก Block size 1,2,4,8 MB จะเหลือแค่ 1 MB

3. Sub-Block size จากเดิมที่เป็น 64K -----> 8K ทำให้ใช้พื้นที่disk ได้อย่างมีประสิทธิภาพมากขึ้น

4. การอัพเกรดจาก 3--->5 ไม่มี downtime คับ (อันนี้สำคัญที่สุด 55)

และพอดีไปเจอตารางเปรียบเทียบ ของทาง VMware มา เลยอยากจะเอามาแชร์ให้คับ

1.จะเห็นได้ว่า VMFS5 นั้นไม่มีลิมิตขนาดDatastore ไว้ที่ 2 TB อีกต่อไป เนื่องจากเปลี่ยนไปใช้ Partition Table แบบ GPT (เหมือนกับของ Windows 2008 )

2. จาก Block size 1,2,4,8 MB จะเหลือแค่ 1 MB

3. Sub-Block size จากเดิมที่เป็น 64K -----> 8K ทำให้ใช้พื้นที่disk ได้อย่างมีประสิทธิภาพมากขึ้น

4. การอัพเกรดจาก 3--->5 ไม่มี downtime คับ (อันนี้สำคัญที่สุด 55)

Thursday, September 22, 2011

New snapshot menu in vSphere 5

วันนี้ผมจะมาขอแนะนำ เมนู snapshot ที่เพิ่มเข้ามาใน version 5 นะคับ

คนที่ลองเล่น version 5 ไปแล้วอาจจะยังไม่สังเกตุเห็นก็ได้ ไม่พุดมากละคับ ดุรุปกันเลยดีกว่า

เอออ แล้วมันมีไว้ทำอะไรละเนี่ย

เมนูนี้ทำขึ้นมาเพื่อแก้ปัญหาที่ทำให้ adminหลายๆคนปวดหัวใน vsphere4 คับ

ใน vSphere4 ถ้ากระบวนการ merge/delete snapshot fail ขึ้นมา สิ่งที่เกิดขึ้นก้คือ ไฟล์snapshot นั้นจะยังคงค้างอยู่ใน Datastore แต่ใน snapshot manager จะไม่โชว์เลยว่ามี snapshot ค้างอยู่ ซึ่งถ้าadmin ไม่เข้าไปดุที่ Datastore หรือ ดูผ่าน Storage View จะไม่มีทางรุ้เลย ซึงการจะลบ snapshot ที่ค้างเหล่านี้ออกไปนั้น จะต้องทำโดยใช้ command line เท่านั้น ไม่สามารถทำผ่าน snapshot manager ได้

ดังนั้นในvSphere เวอชั่น 5 นี้ จึงได้เพิ่มเมนู consolidate ขึ้นมาเพื่อแก้ปัญหาตรงจุดนี้ คับ เราสามารถที่จะสั่ง merge snapshot ได้จากเมนูนี้เลย โดยไม่ต้องไปพึ่ง command line แบบ version 4 อีก

ชีวิตสบายขึ้นอีกเยอะ ^_^

คนที่ลองเล่น version 5 ไปแล้วอาจจะยังไม่สังเกตุเห็นก็ได้ ไม่พุดมากละคับ ดุรุปกันเลยดีกว่า

เอออ แล้วมันมีไว้ทำอะไรละเนี่ย

เมนูนี้ทำขึ้นมาเพื่อแก้ปัญหาที่ทำให้ adminหลายๆคนปวดหัวใน vsphere4 คับ

ใน vSphere4 ถ้ากระบวนการ merge/delete snapshot fail ขึ้นมา สิ่งที่เกิดขึ้นก้คือ ไฟล์snapshot นั้นจะยังคงค้างอยู่ใน Datastore แต่ใน snapshot manager จะไม่โชว์เลยว่ามี snapshot ค้างอยู่ ซึ่งถ้าadmin ไม่เข้าไปดุที่ Datastore หรือ ดูผ่าน Storage View จะไม่มีทางรุ้เลย ซึงการจะลบ snapshot ที่ค้างเหล่านี้ออกไปนั้น จะต้องทำโดยใช้ command line เท่านั้น ไม่สามารถทำผ่าน snapshot manager ได้

ดังนั้นในvSphere เวอชั่น 5 นี้ จึงได้เพิ่มเมนู consolidate ขึ้นมาเพื่อแก้ปัญหาตรงจุดนี้ คับ เราสามารถที่จะสั่ง merge snapshot ได้จากเมนูนี้เลย โดยไม่ต้องไปพึ่ง command line แบบ version 4 อีก

ชีวิตสบายขึ้นอีกเยอะ ^_^

Wednesday, September 21, 2011

Virtual disk defragmentation

ควร defrag disk บน guest OS ไหม?? , แล้วบน Datastore (VMFS) ละควรจะทำด้วยไหม

เป็นคำถามที่ หลายคนสงสัยมาก เนื่องจากเรามักจะdefrag disk กันในเครื่องPhysicalที่รัน Windows เพื่อต้องการประสิทธิภาพในการอ่านและเขียนdiskที่ดีขึ้น แล้วพอย้ายมาเป็น VM เรายังจำเป็นต้องทำกระบวนการตรงนี้อยู่อีกไหม?

ผมจะขอแยกเป็นสองส่วน นั่นคือการทำ defragment บน Guest OS (Windows - NTFS) กับการทำ defragment บน Datastore (VMFS)

ถ้าใช้ disk เป็นแบบ Thick สามารถทำได้คับ แต่ไม่จำเป็นมากนัก เนื่องจาก VM disk นั้นจะอยู่บน share storage การที่defrag guestไปเพียงเครื่องเดียวไม่ได้ทำให้ performance ของ guest เครื่องนั้นดีขึ้นเท่าไหร่ เพราะยังต้องแชร์กะคนอื่น ซึ่งจะต่างจากกรณีเครื่องPhysical (local disk)

VM ที่ใช้ disk เป็น thin, มี snapshot,เป็น link clone,กำลัง backupอยู่ หรือกำลังทำ Storage VMotion พวกนี้ไม่ควรทำ defrag คับจะมีแต่ผลเสีย เนื่องจากจะไปทำให้ขนาดของ thin diskและsnapshot โตขึ้น,ส่งผลต่อ performance อย่างมาก

เนื่องจาก disk defragment นั้นเป็นtaskที่สร้าง I/O สูงมาก ก่อนทำควรคิดให้ดีๆ เนื่องจากอาจจะไปส่งผลกระทบต่อ VM อื่นๆใน Datastore (share storage)นั้นได้

คือจิงๆแล้ว แทบไม่จำเป็นต้องทำเลยคับ เหตุผลคือ virtual disk (vmdk) แต่ละไฟล์นั้นมีขนาดใหญ่ด้วยกันทั้งนั้น อีกทั้งจำนวนไฟล์ก็ไม่ได้ยิบย่อยเหมือนของWindows โอกาสที่จะเกิดfragment ก็มีน้อยคับ

Concept บางอย่างสำหรับเครื่อง Physical ไม่สามารถนำมา apply ใช้ได้กับ โลก Virtual ได้เสมอไปนะคับ

เป็นคำถามที่ หลายคนสงสัยมาก เนื่องจากเรามักจะdefrag disk กันในเครื่องPhysicalที่รัน Windows เพื่อต้องการประสิทธิภาพในการอ่านและเขียนdiskที่ดีขึ้น แล้วพอย้ายมาเป็น VM เรายังจำเป็นต้องทำกระบวนการตรงนี้อยู่อีกไหม?

ผมจะขอแยกเป็นสองส่วน นั่นคือการทำ defragment บน Guest OS (Windows - NTFS) กับการทำ defragment บน Datastore (VMFS)

defragment บน Guest OS (Windows - NTFS)

ถ้าใช้ disk เป็นแบบ Thick สามารถทำได้คับ แต่ไม่จำเป็นมากนัก เนื่องจาก VM disk นั้นจะอยู่บน share storage การที่defrag guestไปเพียงเครื่องเดียวไม่ได้ทำให้ performance ของ guest เครื่องนั้นดีขึ้นเท่าไหร่ เพราะยังต้องแชร์กะคนอื่น ซึ่งจะต่างจากกรณีเครื่องPhysical (local disk)

VM ที่ใช้ disk เป็น thin, มี snapshot,เป็น link clone,กำลัง backupอยู่ หรือกำลังทำ Storage VMotion พวกนี้ไม่ควรทำ defrag คับจะมีแต่ผลเสีย เนื่องจากจะไปทำให้ขนาดของ thin diskและsnapshot โตขึ้น,ส่งผลต่อ performance อย่างมาก

เนื่องจาก disk defragment นั้นเป็นtaskที่สร้าง I/O สูงมาก ก่อนทำควรคิดให้ดีๆ เนื่องจากอาจจะไปส่งผลกระทบต่อ VM อื่นๆใน Datastore (share storage)นั้นได้

defragment บน Datastore (VMFS)

ณ ขณะนี้ยังไม่มี tools มารองรับการทำงานนี้คับ จบ!!คือจิงๆแล้ว แทบไม่จำเป็นต้องทำเลยคับ เหตุผลคือ virtual disk (vmdk) แต่ละไฟล์นั้นมีขนาดใหญ่ด้วยกันทั้งนั้น อีกทั้งจำนวนไฟล์ก็ไม่ได้ยิบย่อยเหมือนของWindows โอกาสที่จะเกิดfragment ก็มีน้อยคับ

Concept บางอย่างสำหรับเครื่อง Physical ไม่สามารถนำมา apply ใช้ได้กับ โลก Virtual ได้เสมอไปนะคับ

Tuesday, September 20, 2011

Virtual machine nic teaming

พอดีผมไปเจอคำถามนึงน่าสนใจดีคับ หลายๆคนที่ก้มีถามคำถามนี้มาเหมือนกัน เลยคืดว่าจะมาช่วยแก้ไขความกระจ่างนี้ให้

ถาม: "เครื่อง physical ผมมี network 1Gb 4 port ทำ teaming กันอยู่ ได้ speed 4Gb , แล้วเครื่องที่เป็น VM ละคับ ผม assign 4 vNic ให้ เหมือนกัน ผมต้องทำ network teaming บน OS เหมือนกันไหม"

ตอบ :ไม่ต้องทำคับ ไปทำ teaming ที่ vswitch ทีเดียวพอคับ

ถาม:อ้าวววทำไมละคับ ก็ที่ทำไปเพื่อจะได้มี Redundancy ไง

ตอบ:virtual nic เป้นแค่ nic จำลอง เป็นแค่ driver , code เท่านั้นเอง ไม่ใช่ของจิง ที่เห็นในVMว่าspeedเป็น 1 Gb นั้น เป็นแค่เลขลวงตาจากการจำลอง network card เนื่องจากพวกนี้วิ่งกันในระดับ kernel(backpane) ,ไม่มีการ limit speed คับ

อ่านเพิ่มเติมได้ที่นี่คับ kb.vmware.com/kb/856

ถาม: อืมๆ งั้นถ้าจะทำ teaming เพื่อเพิ่ม speed ไง จะได้ตั้ง 4 Gb เชียวนะ

ตอบ: คำตอบก้เหมือนเดิมคับ virtual nic เป้น nic จำลองขึ้นมา โดยต่อเข้ากับ vswitch ซึ่งวิ่งอยู่ในkernel ไม่มีการlimit speed คับ ดังนั้น team เป็น 4 Gb หรือไม่backpaneก็วิ่ง speed เท่ากันอยู่ดีคับ

ถาม:งั้นๆถ้าเพิ่ม uplink ที่ vswitch เข้าเป็น 4port ละ

ตอบ:vSwitch ไม่รองรับ LACP (link aggregate) สำหรับ uplink port นะคับ 4 uplink ไม่สามารถเอา 1+1+1+1 ได้คับ

หวังว่า คงจะช่วยไขข้อข้องใจให้ หลายๆคนได้ไม่มากก้น้อยนะคับ

ถาม: "เครื่อง physical ผมมี network 1Gb 4 port ทำ teaming กันอยู่ ได้ speed 4Gb , แล้วเครื่องที่เป็น VM ละคับ ผม assign 4 vNic ให้ เหมือนกัน ผมต้องทำ network teaming บน OS เหมือนกันไหม"

ตอบ :ไม่ต้องทำคับ ไปทำ teaming ที่ vswitch ทีเดียวพอคับ

ถาม:อ้าวววทำไมละคับ ก็ที่ทำไปเพื่อจะได้มี Redundancy ไง

ตอบ:virtual nic เป้นแค่ nic จำลอง เป็นแค่ driver , code เท่านั้นเอง ไม่ใช่ของจิง ที่เห็นในVMว่าspeedเป็น 1 Gb นั้น เป็นแค่เลขลวงตาจากการจำลอง network card เนื่องจากพวกนี้วิ่งกันในระดับ kernel(backpane) ,ไม่มีการ limit speed คับ

อ่านเพิ่มเติมได้ที่นี่คับ kb.vmware.com/kb/856

อีกอย่าง ต่อให้ team vNic กันไป แต่ที่uplinkของ vswitchไม่ได้ทำ teamingไว้ VM ของคุณ network ก็หลุดอยุ่ดี ไม่ว่าจะทำ team ที่ vNic ก้ตาม

ถาม: อืมๆ งั้นถ้าจะทำ teaming เพื่อเพิ่ม speed ไง จะได้ตั้ง 4 Gb เชียวนะ

ตอบ: คำตอบก้เหมือนเดิมคับ virtual nic เป้น nic จำลองขึ้นมา โดยต่อเข้ากับ vswitch ซึ่งวิ่งอยู่ในkernel ไม่มีการlimit speed คับ ดังนั้น team เป็น 4 Gb หรือไม่backpaneก็วิ่ง speed เท่ากันอยู่ดีคับ

อีกอย่าง ถ้า uplink ของ vswitch มีแค่ 1 port จะ team vNic กันกี่ port ปลายทางก็ออกได้แค่ 1 Gb อยู่ดีละคับ

ถาม:งั้นๆถ้าเพิ่ม uplink ที่ vswitch เข้าเป็น 4port ละ

ตอบ:vSwitch ไม่รองรับ LACP (link aggregate) สำหรับ uplink port นะคับ 4 uplink ไม่สามารถเอา 1+1+1+1 ได้คับ

หวังว่า คงจะช่วยไขข้อข้องใจให้ หลายๆคนได้ไม่มากก้น้อยนะคับ

Monday, September 19, 2011

ESXi Multipathing and HCL for Storage/SAN devices

หลายๆคนไม่มากก็น้อย คงอาจจะเคยเข้าไป เช็คกันว่า storage ที่จะนำมาใช้งานกับ vSphere นั้นมันอยู่ใน compatibility list หรือไม่

ถ้าอยู่ใน VMware HCL (HW compatability list) นี้ก็จบ นำไปใช้งานได้ ตามเวอชั่นของ ESX/ESXi นั้นๆ ดังรุป

แต่เคยสังเกตุกันไหมคับว่า ในหน้าเวป VMware HCL นั้น มี criteria ให้ search มากว่า แค่ รุ่น ยี่ห้อ และ fw ของ storage ยิ่งไปกว่านั้น ณ ปัจจุบัน VMware ได้เปลี่ยนเมนู หน้าเวปนี้ใหม่ เอาแบบว่า ดุกันแล้วงงทีเดียว

ผมจะยกตัวอย่างรุปนี้ให้ดุนะคับ

ปล. ถ้าใครไม่เคยเข้าไป ลองตามนี้เลยคับ http://www.vmware.com/resources/compatibility

ใน drop down "What are you looking for" เลือก Storage/SAN

ทางฝั่งซ้ายผมคงไม่ต้องอธิบายอะไรมาก เราน่าจะรุ้ๆกันอยู่ แต่พอหันมาดุฝั่งขวา ........โหหหอะไรเนี่ยเต็มไปหมดเลยยยยยย

ก่อนที่ผมจะมาไล่อธิบายให้ทีละตัว อยากจะขอเกริ่นไว้ก่อนว่า รายละเอียดทางฝั่งขวาทั้งหมดมาจากโครงสร้างของ VMware ที่เรียกว่า PSA (Plugable Storage Architecture) และ VAAI (vStorage API for Array Integration)

-PSA แปลกันตงๆเลยก็คือ โครงสร้าง storage ที่สามารถเขียน Plug-in มาเสียบใช้งานได้ โดย Plug-in เหล่านี้อาจะเป็นของ VMware เอง หรือ ของ Third-party storage เวนเดอร์ก้ได้

-VAAI นั้นจะเป็นความสามารถในการ offload งาน storage บางอย่างจาก ESXi ไปยัง storage แทน

เอาละมาเข้าเรื่องกันดีกว่าผมขอคุยถึง PSA ก่อนนะคับ

จากในรูป ตัวย่อ Plugin หลักๆ3 ตัว นั่นคือ MPP , PSP , SATP

Plug-in เหล่านี้คืออะไร?

พวกนี้คือ Plugin ที่เกี่ยวข้องกับการทำ Multipath ทั้งสิ้น ผมขออธิบายด้วยรุปละกัน

Default Multipath Plugin ที่มากับ VMware คือ NMP (Native Multipath Plugin) มีหน้าที่หลักในการเลือกใช้ sub plugins ( VMware SATP , VMware PSP ) ให้ถูกต้อง

SATP (Storage Array Type Plugin) จะทำหน้าที่คอยตรวจสอบ สถานะของlink หรือ path ระหว่าง ESXi กับ storage controller เพื่อทำการ fail over link/path ในกรณีที่เส่นทางที่ I/O วิ่งอยู่เกิด down ไป

PSP (Path Selection Policy ) ในทางกลับกัน PSP จะเป็นคนคอยตัดสินใจว่า ควรจะ fail over ไปยัง path ไหนตามที่เรากำหนด policy ไว้

โดยที่เวนเดอร์เจ้าอื่นๆก็ สามารถเขียน plug-in เพื่อมาใช้งานแทน plug-in ของทาง VMware ได้

ในช่อง SATP Plugin ของ VMware HCL จะเห็นประเภทของSATP ต่างๆโดยพวกนี้จะขึ้นกับ Storage ที่นำมาเชื่อมต่อ , VMW_SATP_XX คือ SATP ของทาง VMware เอง โดยXX จะแทนรูปแบบ/รุ่น ของ Storage เช่น EQL =Equal Logic , SYMM = Symmetrix

เช่นเดียวกัน PSP Plugin ก็จะมีประเภทของ policy ที่ใช้ในการเลือกเส้นทางที่จะส่ง I/O (default policy ของ ทางVMware มีทั้งหมด สี่แบบด้วยกัน )

MRU (Most Recently Used) จะพยายามเลือกใช้เส้นทางที่ปัจจุบันที่สุดเพียงเส้นเดียวเสมอ

FIXED ตรงไปตรงมาคับ จะพยายามใช้เส้นที่เราเลือกไว้เพียงเส้นเดียวเสมอ

Round Robin จะสลับ I/O ไปมาระหว่างแต่ละ path ไม่ตายตัวเหมือนสองอันแรก โดยขึ้นกับสองเงื่อนไข (จำนวน I/O , Bytes)

VMW_PSP_FIXED_AP ESXi จะเป็นคนเลือกเองว่าควรจะใช้เส้นไหน

แล้วจะเลือกใช้อันไหนดีละ ? รอดุตัวอย่างนะคับ ต่อไปผมจะพุดถึง VAAI บ้าง

VAAI มีไว้ทำอะไร

VAAI จะช่วยให้ ESXi สามารถแบ่งเบาภาระงาน I/O บางอย่างออกจากตัวเองไปลงที่ storage ได้ ซึ่งไม่ใช่ทุก storage ที่จะ support ตรงนี้

โดยหลักๆแล้ว จะมีงานสามแบบที่ VAAI offloadได้ นั้นคือ Block-Zero , Full copy , HW assist Locking ผมจะไม่ขอลงลึกนะคับ ถ้าสนใจมากว่านี้ ไว้โพสถามมาละกัน ยกตัวอย่างเช่น

Full copy แทนที่จะให้ESXi เป็นคนก้อป (I/O วิ่งผ่าน VMkernel) ESXi จะก็สั่งให้ storage copy ให้แทน ซึ่งจะทำให้เวลาในการ copy ลดลงไป

ถ้าอยู่ใน VMware HCL (HW compatability list) นี้ก็จบ นำไปใช้งานได้ ตามเวอชั่นของ ESX/ESXi นั้นๆ ดังรุป

แต่เคยสังเกตุกันไหมคับว่า ในหน้าเวป VMware HCL นั้น มี criteria ให้ search มากว่า แค่ รุ่น ยี่ห้อ และ fw ของ storage ยิ่งไปกว่านั้น ณ ปัจจุบัน VMware ได้เปลี่ยนเมนู หน้าเวปนี้ใหม่ เอาแบบว่า ดุกันแล้วงงทีเดียว

ผมจะยกตัวอย่างรุปนี้ให้ดุนะคับ

ปล. ถ้าใครไม่เคยเข้าไป ลองตามนี้เลยคับ http://www.vmware.com/resources/compatibility

ใน drop down "What are you looking for" เลือก Storage/SAN

ทางฝั่งซ้ายผมคงไม่ต้องอธิบายอะไรมาก เราน่าจะรุ้ๆกันอยู่ แต่พอหันมาดุฝั่งขวา ........โหหหอะไรเนี่ยเต็มไปหมดเลยยยยยย

ก่อนที่ผมจะมาไล่อธิบายให้ทีละตัว อยากจะขอเกริ่นไว้ก่อนว่า รายละเอียดทางฝั่งขวาทั้งหมดมาจากโครงสร้างของ VMware ที่เรียกว่า PSA (Plugable Storage Architecture) และ VAAI (vStorage API for Array Integration)

-PSA แปลกันตงๆเลยก็คือ โครงสร้าง storage ที่สามารถเขียน Plug-in มาเสียบใช้งานได้ โดย Plug-in เหล่านี้อาจะเป็นของ VMware เอง หรือ ของ Third-party storage เวนเดอร์ก้ได้

-VAAI นั้นจะเป็นความสามารถในการ offload งาน storage บางอย่างจาก ESXi ไปยัง storage แทน

เอาละมาเข้าเรื่องกันดีกว่าผมขอคุยถึง PSA ก่อนนะคับ

จากในรูป ตัวย่อ Plugin หลักๆ3 ตัว นั่นคือ MPP , PSP , SATP

Plug-in เหล่านี้คืออะไร?

พวกนี้คือ Plugin ที่เกี่ยวข้องกับการทำ Multipath ทั้งสิ้น ผมขออธิบายด้วยรุปละกัน

Default Multipath Plugin ที่มากับ VMware คือ NMP (Native Multipath Plugin) มีหน้าที่หลักในการเลือกใช้ sub plugins ( VMware SATP , VMware PSP ) ให้ถูกต้อง

SATP (Storage Array Type Plugin) จะทำหน้าที่คอยตรวจสอบ สถานะของlink หรือ path ระหว่าง ESXi กับ storage controller เพื่อทำการ fail over link/path ในกรณีที่เส่นทางที่ I/O วิ่งอยู่เกิด down ไป

PSP (Path Selection Policy ) ในทางกลับกัน PSP จะเป็นคนคอยตัดสินใจว่า ควรจะ fail over ไปยัง path ไหนตามที่เรากำหนด policy ไว้

โดยที่เวนเดอร์เจ้าอื่นๆก็ สามารถเขียน plug-in เพื่อมาใช้งานแทน plug-in ของทาง VMware ได้

ในช่อง SATP Plugin ของ VMware HCL จะเห็นประเภทของSATP ต่างๆโดยพวกนี้จะขึ้นกับ Storage ที่นำมาเชื่อมต่อ , VMW_SATP_XX คือ SATP ของทาง VMware เอง โดยXX จะแทนรูปแบบ/รุ่น ของ Storage เช่น EQL =Equal Logic , SYMM = Symmetrix

เช่นเดียวกัน PSP Plugin ก็จะมีประเภทของ policy ที่ใช้ในการเลือกเส้นทางที่จะส่ง I/O (default policy ของ ทางVMware มีทั้งหมด สี่แบบด้วยกัน )

MRU (Most Recently Used) จะพยายามเลือกใช้เส้นทางที่ปัจจุบันที่สุดเพียงเส้นเดียวเสมอ

FIXED ตรงไปตรงมาคับ จะพยายามใช้เส้นที่เราเลือกไว้เพียงเส้นเดียวเสมอ

Round Robin จะสลับ I/O ไปมาระหว่างแต่ละ path ไม่ตายตัวเหมือนสองอันแรก โดยขึ้นกับสองเงื่อนไข (จำนวน I/O , Bytes)

VMW_PSP_FIXED_AP ESXi จะเป็นคนเลือกเองว่าควรจะใช้เส้นไหน

แล้วจะเลือกใช้อันไหนดีละ ? รอดุตัวอย่างนะคับ ต่อไปผมจะพุดถึง VAAI บ้าง

VAAI มีไว้ทำอะไร

VAAI จะช่วยให้ ESXi สามารถแบ่งเบาภาระงาน I/O บางอย่างออกจากตัวเองไปลงที่ storage ได้ ซึ่งไม่ใช่ทุก storage ที่จะ support ตรงนี้

โดยหลักๆแล้ว จะมีงานสามแบบที่ VAAI offloadได้ นั้นคือ Block-Zero , Full copy , HW assist Locking ผมจะไม่ขอลงลึกนะคับ ถ้าสนใจมากว่านี้ ไว้โพสถามมาละกัน ยกตัวอย่างเช่น

Full copy แทนที่จะให้ESXi เป็นคนก้อป (I/O วิ่งผ่าน VMkernel) ESXi จะก็สั่งให้ storage copy ให้แทน ซึ่งจะทำให้เวลาในการ copy ลดลงไป

เอาละสุดท้ายแล้ว ผมจะให้ดุละกันคับว่า ที่กล่าวมาทั้งหมดนั้นเรานำไปประยุกต์ใช้ในการอ่าน VMware HCL ได้อย่างไร

Hello Everyone!!!

ในที่สุดก็มี blog เป็นของตัวเองซักที -__-"

Blog นี้อุทิศให้กับงานของผม ซึ่งเกี่ยวข้องกับ Virtualization Technology เป็นหลัก

แหะๆ เน้นไปทาง VMware นะคับ

ผมจะพยายามมาแชร์ ประสบการณ์การทำงาน ปัญหาที่เจอต่างๆ รวมไปถึงการขอคำปรึกษาแนะนำกูรูทั้งหลาย บน blog นี้ เพื่อเป็นแนวทางช่วยเหลือ IT คนอื่นๆ

มีข้อสงสัยอะไร มีไรมาแนะนำ มาแชร์กันได้คับ ^_^

ในที่สุดก็มี blog เป็นของตัวเองซักที -__-"

Blog นี้อุทิศให้กับงานของผม ซึ่งเกี่ยวข้องกับ Virtualization Technology เป็นหลัก

แหะๆ เน้นไปทาง VMware นะคับ

ผมจะพยายามมาแชร์ ประสบการณ์การทำงาน ปัญหาที่เจอต่างๆ รวมไปถึงการขอคำปรึกษาแนะนำกูรูทั้งหลาย บน blog นี้ เพื่อเป็นแนวทางช่วยเหลือ IT คนอื่นๆ

มีข้อสงสัยอะไร มีไรมาแนะนำ มาแชร์กันได้คับ ^_^

Subscribe to:

Posts (Atom)